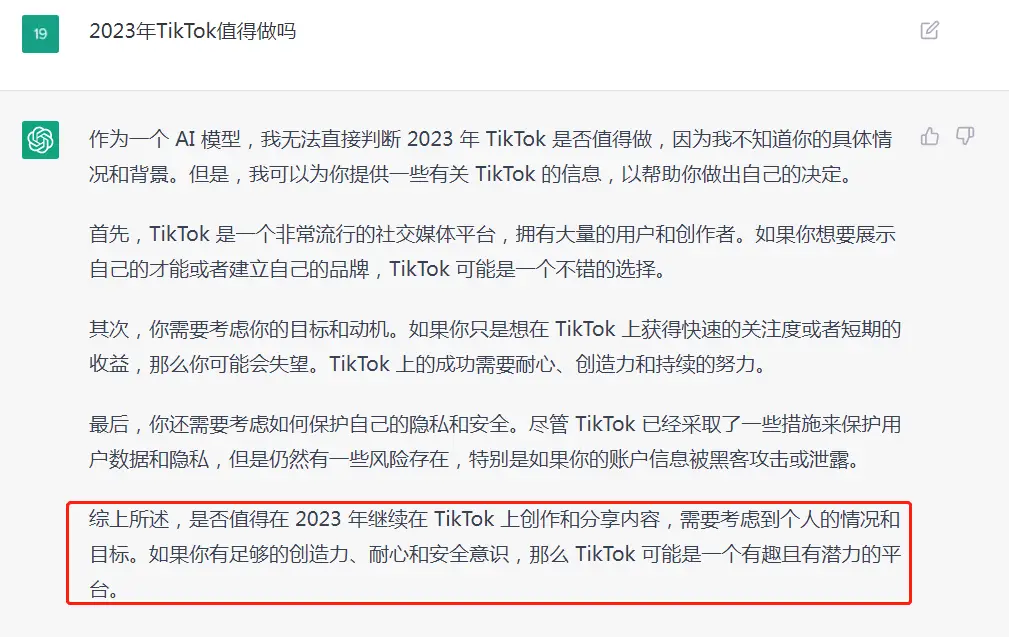

AI智能聊天工具不断迭代,免费无限量使用的R1模型会带来怎样的惊喜?它与GPT – 4相比又有何优劣?让我们一探究竟。

GPT – 4参数揭秘

![图片[1]-7月13日消息!外媒揭秘GPT-4大模型,参数等信息全公开?-东山笔记](https://83ch.com/wp-content/uploads/2025/08/1756534194545_0.png)

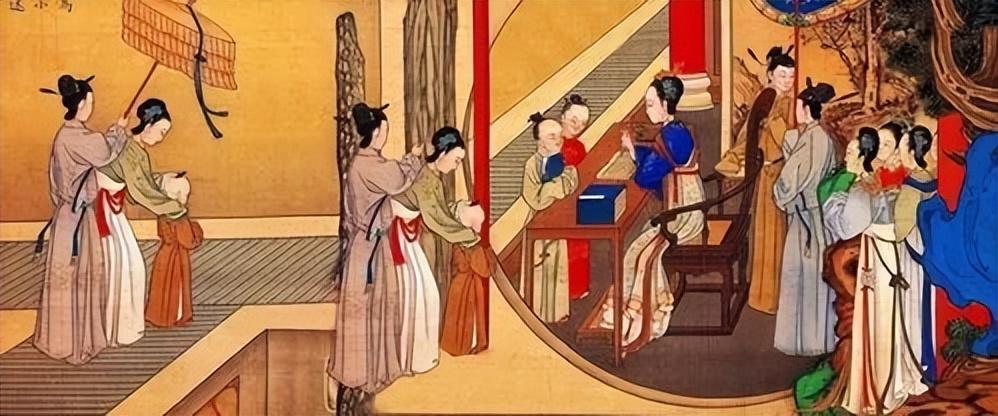

外媒近日揭秘了今年3月发布的GPT – 4大模型。GPT – 4在120层中总共包含1.8万亿参数,而GPT – 3只有约1750亿个参数。如此巨大的参数差距,意味着GPT – 4在处理复杂任务和语言理解上有更强的能力,能给出更精准和详细的回答。

混合专家模型构建

![图片[2]-7月13日消息!外媒揭秘GPT-4大模型,参数等信息全公开?-东山笔记](https://83ch.com/wp-content/uploads/2025/08/1756534194545_1.png)

为保持合理成本,GPT – 4采用混合专家模型构建。该模型是一种神经网络,会根据数据分离训练多个模型,最后整合输出单个任务的结果。GPT – 4使用了16个混合专家模型,每个有1110亿个参数,每次前向传递路由经过两个专家模型,这种方式能在性能与成本间找到平衡。

训练数据集情况

GPT – 4使用包含13万亿token的数据集训练,且token并非唯一,随着迭代次数会更多。丰富的训练数据让GPT – 4能学习到更广泛的知识,拥有更强大的语言生成和问题解答能力,无论是日常交流还是专业领域问题都能应对。

上下文长度差异

![图片[3]-7月13日消息!外媒揭秘GPT-4大模型,参数等信息全公开?-东山笔记](http://83ch.com/10.png)

GPT – 4预训练阶段上下文长度为8k,32k版本是对8k微调的结果。上下文长度影响着模型对长文本的理解和处理能力,32k版本能处理更长的文本,提供更连贯的回答,但训练成本相当高。

![图片[4]-7月13日消息!外媒揭秘GPT-4大模型,参数等信息全公开?-东山笔记](https://83ch.com/wp-content/uploads/2025/08/1756534194545_3.jpg)

高昂训练成本

外媒表示,8x H100也无法以每秒33.33个Token的速度提供所需的密集参数模型,训练该模型推理成本极高。以H100物理机每小时1美元计算,一次训练成本高达6300万美元(约4.51亿元人民币),这对研发方是巨大的经济压力。

成本降低策略

面对高昂成本,选择使用云端的A100 GPU训练模型,将最终训练成本降至2150万美元(约1.54亿元人民币)左右。虽然花费时间稍长,但有效降低了成本,让模型的研发和推广更具可行性。

免费无限量使用的R1模型能否在性能上追赶GPT – 4,又能否在成本控制上做得更好呢?欢迎大家评论分享看法,也请点赞转发本文。